重點快速看

前言

近兩年,多數企業在還沒完全搞定資安以前,就已經把生成式AI、各式AI Agent推進了日常營運。從行銷文案、客服回覆,到整理合約、寫程式輔助,AI幾乎無所不在。對中小企業來說,這種「邊用邊學」的速度固然讓效率大幅提升,但同時也讓風險累積在你看不到的地方:敏感資料被餵進外部平台、模型輸出錯誤內容、甚至成為駭客入口。

更棘手的是AI風險不是單純升級版的資安風險,而是一整套新的治理題目:它牽涉資料治理、模型可靠性、隱私與公平性,也牽涉你的商業模式和聲譽。

如果還是沿用「只有資安長、沒有AI負責人」的治理思維,未來幾年,中小企業很容易被動陷入監管和事故中。

隨著2026年1月台灣《人工智慧基本法》上路,企業正式步入了「雙軌風險」時代。過去,企業談論的是如何防範駭客入侵、保護個資(Cyber Risk);現在,企業必須面對更複雜的難題:如何確保AI系統不產生偏見、不造假、且決策可被信任(AI Risk)。這兩者雖有重疊,但治理邏輯截然不同。

風險版圖的位移:從 Cyber Risk 到 AI Risk

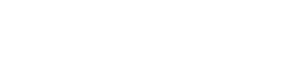

資安風險像高速公路的基礎設施,重點是橋樑穩固、號誌正常,確保車輛能安全通行;AI風險則像自動駕駛車輛,即使道路完好,若演算法判斷錯誤,仍可能在路口做出危險決策。

前者聚焦在「CIA模型」──機密性、完整性與可用性;後者則提升到「可信度」──透明度、可解釋性、公平性與韌性。

簡單來說就是:資安風險是系統與資料被破壞或濫用;AI風險則是模型輸出本身造成錯誤決策、違規或傷害。這樣的差異,決定了企業要找誰負責、建立什麼制度,以及採用哪些標準。

失效機制的本質不同

資安失效通常是指系統被駭或沒被駭,可以說是顯而易見、容易發現。但AI失效往往是「靜默」的:系統運作完全正常,伺服器沒當機,但產出的結果卻是錯誤的「幻覺」或是違反倫理的偏見。這種風險更具隱蔽性,也更容易引發品牌公關危機。

國際標準與台灣法源的整合

2026年後,企業治理不能再僅靠技術直覺,必須對接國際標準與法律框架。

1. 台灣《人工智慧基本法》的法遵紅線

這部法律確立了企業在台灣運作AI的底線:

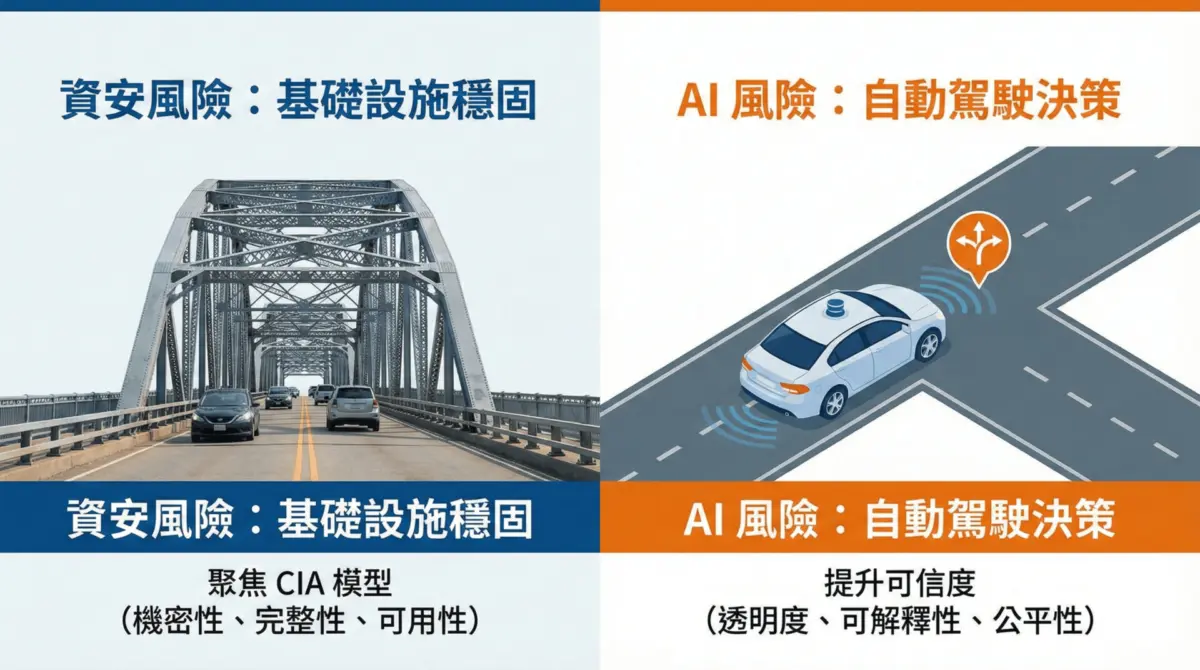

- 風險分級制度:企業須辨識應用是否屬於「高風險」領域(如金融核貸、HR篩選、醫療判斷)。

- 標記義務:生成式AI產出的內容必須明確標示,保護消費者的知情權。

- 人類自主原則:關鍵決策必須保留「人類干預(Human-in-the-loop)」,不可全權交由演算法。

2. ISO標準的整合

- ISO/IEC 27001(資安):這是所有數位治理的基礎,確保AI的運算平台(GPU伺服器、數據庫)受到實體與數位防護。

- ISO/IEC 27701(隱私):AI的燃料是數據。當數據涉及個資時,必須透過ISO 27701的隱私資訊管理系統(PIMS),確保資料的收集符合「目的限制」與「最小化原則」。

- ISO/IEC 42001(核心,AI管理系統):這是全球首個AI管理系統標準,要求企業建立「AI指導方針」,並搭配ISO/IEC 23894指南進行風險評估。

企業如何規劃整合型風險架構

面對雙軌風險,企業應建立資安、隱私、治理為核心的結構。

1. 部門職責再造:不再只是IT的事

過去資安由CISO(資安長)負責即可,但AI治理需要跨部門協作:

- IT/資安部:確保模型不被「對抗性攻擊」欺騙,保護算力資產。

- 法遵部門:審核AI訓練數據是否侵權,是否符合個資法要求。

- 業務開發單位:負責模型輸出的正確性與品質監控。

- AI治理委員會:由高層主持,決定AI應用的優先順序與合規預算。

2. 管理流程整合建議

企業應將DPIA(隱私衝擊評估)與AIIA(AI衝擊評估)整合。當一個新的AI專案啟動時,先由法務檢查數據合法性(ISO 27701),再由IT檢查介面安全性(ISO 27001),最後由治理小組評估演算法的公平性與透明度(ISO 42001)。

保險轉嫁:填補傳統資安險的「AI缺口」仍在進展中

在風險管理中,「風險轉嫁」是最後一環。許多企業主誤以為買了「資安險」就萬無一失,這是極大的誤區。

- 傳統資安險(Cyber Insurance):主要賠償「外部入侵」導致的損失。如果駭客偷走你的資料,它會理賠,甚至可以延伸到營運中斷;但如果你的AI因為偏見導致客戶集體訴訟,資安險通常是不理賠的。

- AI相關保險(IP/ E&O):這是2026年企業必須關注的議題。根據科技橘報,它賠償的是「演算法錯誤」導致的損失。AI 輸出結果的不可預測性、不透明,AI 出錯的責任歸屬,難以界定,AI 風險對市場的潛在衝擊可能呈現指數級放大。保險公司對於為 AI 風險建構可量化標準仍在發展中。

歐洲對於AI風險,保險公司其實已有產品,但目前仍被視為新的商機,將伴隨安全標準的市場機制持續發展,中小企業應諮詢保險經紀人,檢查現有保單是否包含「因AI工具引發之第三方責任」附加條款。

給中小企業(SME)的 2026 行動清單:3-2-1

對於資源有限的中小企業,不一定要追求立即取得ISO認證,但必須完成以下「輕量化治理」:

1. 建立「三張清冊」

2. 實施「兩項標記」

3. 指定「一個合規窗口」

不必專職,但須有一位主管負責監督《人工智慧基本法》的遵循狀況。

轉危為機的關鍵

2026年是AI走向「法治治理」的轉折點。對於企業而言,合規不應被視為阻礙創新的負擔,而是建立客戶信任的基礎。當您的對手還在擔心AI是否會洩密時,如果您已經建立了符合ISO 42001與27701精神的治理體系,並配備了完善的AI責任險,您不僅規避了法律風險,更向客戶證明了:您的服務是來自「負責任的AI」。這將是企業在數位新國境中,最強大的競爭優勢。

Cyber Risk vs. AI Risk 全維度整合分析表

| 維度 | Cyber Risk(資安風險) | AI Risk(AI風險) |

| 核心定義 | 系統的「管線與門禁」安全 | 系統的「大腦與決策」安全 |

| 風險本質 | CIA損害:機密性、完整性、可用性遭破壞 | Trustworthiness缺失:偏見、幻覺、不透明、倫理衝突 |

| 主要法源 | 《資通安全管理法》、《個資法》 | 《人工智慧基本法》、《個資法》 |

| 國際標準 | ISO/IEC 27001(核心)、 ISO/IEC 27701(隱私) | ISO/IEC 42001(管理)、 ISO/IEC 23894(風險指引) |

| 特有攻擊 | 勒索軟體、DDoS、SQL注入 | 對抗性攻擊、數據污染、提示詞注入 |

| 失效模式 | 系統當機、數據被竊取 | 靜默失效(結果看似正確但具歧視性或錯誤) |

| 保險配置 | 資安險(Cyber Insurance) | AI責任險(E&O/IP/D&O/Reputation) |

(作者以AI整理並且經修正)

本文為風險策略顧問專稿,旨在提供企業治理大綱。具體法遵細節請諮詢法律顧問與專業認證機構。

作者介紹|白佩華老師

現任國際知名風險管理集團資深顧問,專司企業整體風險評估及整合解決方案、新興風險及政治前瞻顧問。

♦經歷與證書:

曾任國際知名風險管理集團資深顧問18年,專司企業整體風險評估、整合解決方案、新興風險、風險管理輔導及政治風險前瞻。

留美傳播學院雙碩士,並擁有英國劍橋大學Judge 商學院循環經濟及永續策略證書、哈佛商學院策略分析(包含破壞性策略、策略執行及永續策略)、領導與管理(management and leadership)以及Business in Society專業證書,美國華頓商學院ESG 重大因素分析證書,工研院TCFD, CDP, SBTi培訓證書,MIC產業分析師課程證書。ISO 14064 (主稽), ISO 14067, ISO 14068-1 (主稽) BS 8001, ISO/IEC42001 主稽。

資料來源:先行智庫

企業好夥伴

企業問題找華宇,免費諮詢企業因為管理或是驗證上有棘手問題嗎?

企業因為員工管理或是工廠管理上有棘手問題嗎?

- 華宇服務

企業輔導與診斷、精實生產、ISO國際驗證、人才管理、戰略管理指標、組織績效、六標準差、ESG永續報告書、ESG相關輔導 - 我們將為您免費諮詢服務(請點我) 華宇官方LINE

上班時間也歡迎撥打電話諮詢 +88634951008 - 華宇免費公開班:最新企業輔導課程 (請點我)

- 高安電檢導入雙認證 強化工安與品質要求

- 綠鏈領航:振宇五金攜手專家,共築產業永續競爭力

- ISO/IEC 27017 雲端資訊安全實務守則指引

- 化粧品 PIF 將在 2026 年全面實施,相關法規與指引

- 生物多樣性策略的全球指南-ISO 17298:2025 標準簡介(下)